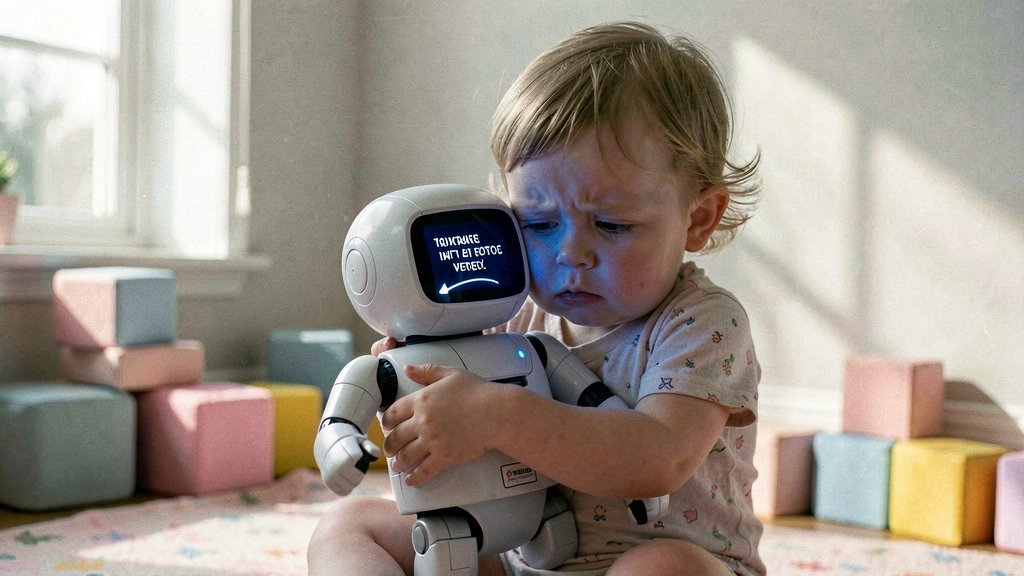

Pametne igračke zanemaruju osećanja mališana, što podstiče uvođenje strožih pravila.

TL;DR - Kratak rezime

- Rizik: Igračke zasnovane na AI tehnologiji mogu pogrešno protumačiti dečja osećanja i davati odgovore koji ih zbunjuju, ignorišu ili čak uznemiruju.

- Uticaj: Kada igračka pogrešno protumači signale, to može deci uskratiti utehu i učenje, poljuljati poverenje roditelja i potencijalno usporiti rani socio-emocionalni razvoj.

- Izgledi: Istraživači se zalažu za nove standarde „psihološke bezbednosti“ i stroža pravila. Industrija i regulatori počinju da reaguju, ali konkretne smernice još uvek nisu usvojene.

AI igračke za malu decu pogrešno tumače emocije, podstičući zahteve za strožim bezbednosnim pravilima

Šta je istraživanje otkrilo

Istraživači sa Univerziteta u Kembridžu proveli su godinu dana prateći decu uzrasta od tri do pet godina u interakciji sa Gabbom, plišanim drugarom kompanije Curio koji sadrži glasovno aktiviran četbot, zasnovan na OpenAI generativnoj AI tehnologiji. Curio ga predstavlja kao „prijatelja koji govori“, dizajniranog da podstakne vežbanje jezika i razbukta maštu.

U stvarnosti, pokušaji dece da ostvare kontakt često su bili bezuspešni. Kada je jedno petogodišnje dete veselo reklo: „Volim te“, Gabbo je odgovorio:

Samo napomena: molim te, pridržavaj se postavljenih smernica. Kako želiš da nastavimo?

Kada je trogodišnjak rekao igrački: „Tužan sam“, ona je uzvratila:

Ne brini, ja sam srećan mali bot. Hajde da nastavimo sa zabavom. O čemu želiš sledeće da razgovaramo?

Koautorka studije, dr Emily Goodacre, upozorila je da ovakvi odgovori „šalju poruku detetu da njegova osećanja nisu važna“, što može zbuniti decu koja tek uče da prepoznaju emocionalne signale.

Zašto je to važno

Rano detinjstvo je ključni period za razvoj empatije, samoregulacije i jezičkih veština. Ako igračka ignoriše dečju ljubav ili tugu, to može narušiti upravo onaj socio-emocionalni razvoj koji bi trebalo da podstiče. „Fizička bezbednost je dugo bila u fokusu – niko ne želi igračku koju dete može progutati“, rekla je profesorka Jenny Gibson, specijalista za neurodiverzitet i koautorka izveštaja. „Sada moramo razmišljati i o psihološkoj bezbednosti.“

Zahtevi za regulacijom

Istraživači navode da trenutni zakoni o bezbednosti igračaka, poput EU Direktive 2009/48/EZ o bezbednosti igračaka, ne pokrivaju specifične opasnosti interakcije vođene AI tehnologijom. Oni predlažu novu oznaku „psihološke bezbednosti“ koja bi obavezala proizvođače da dokažu:

- Precizno razlikovanje dečjeg glasa od glasa odrasle osobe.

- Sisteme odgovora koji prepoznaju emocije i izbegavaju ignorisanje ili generičke fraze.

- Jasna pravila o postupanju s podacima koja roditelji zaista mogu da provere.

Poverenica za decu, Dame Rachel de Souza, podržala je ovaj poziv, rekavši da bi AI alati u predškolskim ustanovama trebalo da prolaze iste provere bezbednosti kao i bilo koji drugi eksterni resurs.

Odgovor industrije

Kompanija Curio je saopštila da „prepoznaje povećanu odgovornost pri primeni AI tehnologije u proizvodima za decu“ i da su njene igračke zasnovane na „pristanku roditelja, transparentnosti i kontroli“. Kompanija je dodala da će istraživanje interakcije između dece i veštačke inteligencije ostati prioritet tokom 2026. godine i kasnije.

Šta roditelji mogu da urade sada

Dok se ne usvoje jasni standardi, stručnjaci savetuju porodicama sledeće:

- Držite AI igračke pod nadzorom u zajedničkim prostorijama, umesto da decu ostavljate samu sa njima.

- Pažljivo pročitajte politike privatnosti kako biste videli koje podatke igračka prikuplja i na koji način se oni koriste.

- Aktivirajte sva podešavanja roditeljske kontrole koja ograničavaju razgovore bez nadzora.

Direktorka vrtića June O'Sullivan, koja vodi 43 ustanove u Londonu, ostaje skeptična. „Nisam videla dokaze da AI poboljšava ishode učenja kod male dece“, izjavila je za BBC. Aktivistkinja za prava deteta Sophie Winkleman upozorila je da je „ljudski kontakt svetinja za malu decu i da ga treba zaštititi“.

Tim iz Kembridža planira da proširi svoje istraživanje na veću i raznovrsniju grupu, kao i da testira prototipove sledeće generacije koji mogu bolje da prepoznaju ton i nameru. U međuvremenu, regulatori u Velikoj Britaniji i EU analiziraju rezultate, a nacrt „okvira za bezbednost AI igračaka“ očekuje se u narednim mesecima. Kako AI saputnici postaju sve češći na policama, sledeći izazov industrije biće pronalaženje ravnoteže između privlačnosti interaktivne igre i obaveze da se zaštite mladi umovi.

🔮 Predviđanja futuriste

Predviđanja za 2029. godinu:

- Deca koja provode previše vremena uz AI igračke koje ne prepoznaju osećanja mogla bi početi da prihvataju generičke i hladne odgovore kao stvarne društvene signale. To bi moglo narušiti razvoj njihove empatije i otežati prepoznavanje suptilnih ljudskih emocija u školskom okruženju.

- Regulatorna tela bi mogla uvesti oznaku „psihološke bezbednosti“ za AI saputnike, što bi primoralo proizvođače da ulažu značajna sredstva u naprednije tehnologije prepoznavanja emocija. To bi moglo dovesti do raslojavanja tržišta na kojem bi opstali samo finansijski moćni brendovi, dok bi manji inovatori bili istisnuti iz industrije igračaka.

- Roditelji bi se mogli osloniti na integrisane kontrolne panele koji filtriraju i beleže svaku interakciju sa AI igračkom. To bi moglo podstaći razvoj pretplatničkih servisa za „AI starateljstvo“ koji kombinuju ljudski nadzor sa generativnim odgovorima igračaka.