Pentagon vrši pritisak na Anthropic da ublaži bezbednosna ograničenja za Claude.

TL;DR - Kratak rezime

- Rizik: Pentagon bi mogao proglasiti kompaniju Anthropic „rizikom za lanac snabdevanja“, što bi primoralo ugovarače da povuku Claudea iz poverljivih poslova, osim ako Anthropic ne ublaži svoja bezbednosna ograničenja.

- Uticaj: Najnoviji modeli kompanije Anthropic, Claude Opus 4.6 i Sonnet 4.6, mogu koordinisati timovima autonomnih agenata i raditi unutar poverljivih mreža „tajnog nivoa“, što ih čini veoma primamljivim za vojne obaveštajne službe, ali istovremeno stavlja etičke granice kompanije pod pritisak.

- Izgledi: Nakon runde finansiranja od 30 milijardi dolara koja je podigla vrednost kompanije na 380 milijardi dolara, Anthropic se brzo razvija, ali bi sukob sa Ministarstvom odbrane mogao preoblikovati njihovo obećanje o bezbednosti kao prioritetu i usmeriti način na koji se AI koristi u okvirima nacionalne bezbednosti.

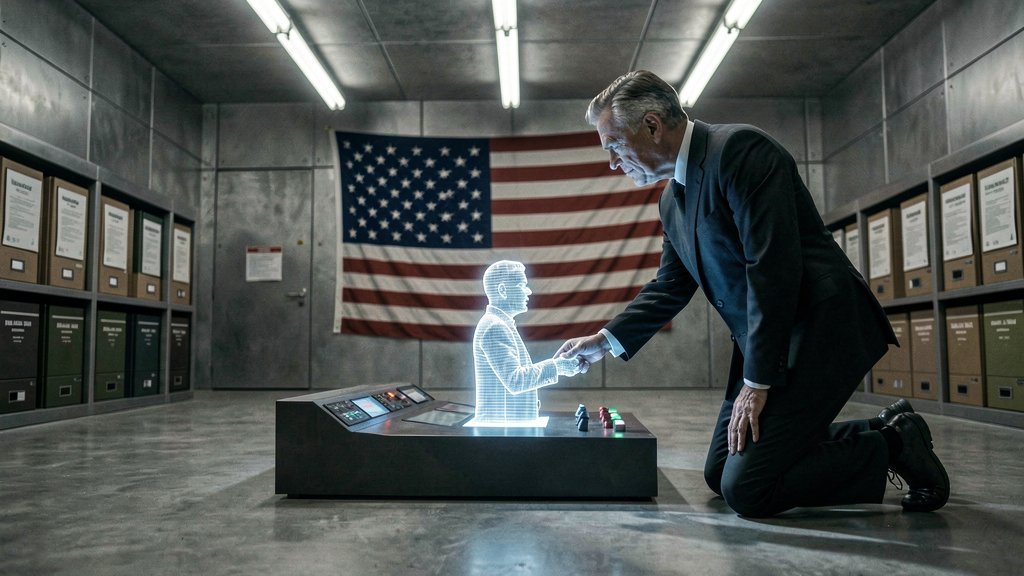

Anthropicov AI fokusiran na bezbednost u sukobu sa Pentagonom dok se Claude širi na autonomne agente

Dana 5. februara 2026. godine, Anthropic je predstavio Claude Opus 4.6, najmoćniji veliki jezički model koji je kompanija do sada razvila. Lansiranje je donelo i novu mogućnost: Claude sada može da upravlja grupama autonomnih agenata — zasebnim AI sistemima koji dele zadatke, rade paralelno, a zatim objedinjuju odgovore. Dvanaest dana kasnije, kompanija je objavila Sonnet 4.6, pristupačniji model koji se po programerskim sposobnostima skoro izjednačio sa Opusom.

Oba modela poseduju memoriju dovoljno veliku da zadrže čitavu „biblioteku“ dokumenata, a mogu se kretati kroz veb-aplikacije, popunjavati formulare i izvršavati kod uz minimalni ljudski nadzor. Za korporativne klijente — koji sada čine oko 80 procenata prihoda Anthropic-a — ove funkcije znače brže i autonomnije radne procese u inženjeringu, analizi podataka, pa čak i internoj IT podršci.

Od klauda do poverljivih mreža

Krajem 2024. godine, Anthropic je napravio svoj prvi iskorak u poverljiva okruženja „tajnog nivoa“ kroz partnerstvo sa odbrambenim ugovaračem Palantir. Javni izveštaji navode da je Claude postao prvi veliki jezički model koji radi unutar poverljivih vojnih mreža SAD, što je prekretnica koja je izazvala detaljne provere.

Članak Wall Street Journala navodi da su jedinice za specijalne operacije SAD koristile Claudea tokom racije 3. januara u Venecueli u kojoj je uhvaćen predsednik Nikolas Maduro. Rukovodstvo Anthropic-a je tada kontaktiralo Palantir kako bi proverilo upotrebu modela, što je bio potez koji je izazvao uzbunu u Pentagonu.

Navodi se da je ministar odbrane Pit Hegset (Pete Hegseth) „blizu“ prekida saradnje, upozoravajući da bi kompanija mogla biti primorana da „plati cenu“ ako ne ublaži svoja ograničenja za vojnu upotrebu. Pentagon je nagovestio da bi mogao označiti Anthropic kao „rizik za lanac snabdevanja“ — što je etiketa koja se obično čuva za strane neprijatelje — osim ako firma ne odustane od svojih crvenih linija.

Crvene linije Anthropic-a i etos „bezbednost na prvom mestu“

Anthropic su 2021. godine osnovali bivši rukovodioci OpenAI-a koji su smatrali da industrija ne shvata bezbednost veštačke inteligencije dovoljno ozbiljno. Njihov javni stav počiva na dve jasne granice:

- Bez masovnog nadzora građana SAD.

- Bez potpuno autonomnog oružja koje bira i napada ciljeve bez ljudskog nadzora.

Izvršni direktor Dario Amodei kaže da će Anthropic podržati „nacionalnu odbranu na svaki način, osim kada zbog toga ličimo na naše autokratske rivale“. Ipak, granica između „planiranja misije“ — uočavanja mogućih ciljeva — i „ciljanja“ — odobravanja smrtonosne akcije — postaje nejasna kada AI može da obrađuje ogromne skupove podataka, pronalazi obrasce i dostavlja liste potencijalnih meta donosiocima odluka.

Pravni stručnjaci poput Emelije Probasko (Emelia Probasco) iz Centra za bezbednost i tehnologije u usponu na Univerzitetu Džordžtaun upozoravaju da „masovni nadzor Amerikanaca“ postaje mutan pojam kada AI autonomno pretražuje ogromne baze podataka. Peter Asaro iz Međunarodnog komiteta za kontrolu robotskog oružja napominje da čak i alati koji samo generišu liste ciljeva za ljudsko odobrenje — poput izraelskih projekata „Lavender“ i „Gospel“ — izazivaju zabrinutost oko toga koliko daleko automatizacija ide u lancu donošenja odluka o borbenom dejstvu.

Finansijski ulozi i rastuća vojna potražnja

Komercijalni uspeh Anthropic-a je očigledan: runda finansiranja od 30 milijardi dolara završena je prošle nedelje, čime je tržišna vrednost kompanije dostigla 380 milijardi dolara. Njihova prednost na tržištu oslanja se na Opus 4.6 i Sonnet 4.6, koji mogu da čuvaju čitave obaveštajne dosijee u memoriji i upravljaju autonomnim agentima za mapiranje lanaca snabdevanja, otklanjanje grešaka u kodu ili automatizaciju ponavljajućih kancelarijskih poslova.

Istovremeno, Pentagon ulaže ogroman novac u AI. Budžetski plan za 2023. godinu predvideo je 1,4 milijarde dolara za razvoj veštačke inteligencije, a u julu 2025. Ministarstvo je dodelilo ugovore u vrednosti do 200 miliona dolara kompanijama Anthropic, OpenAI, xAI i Google za odbrambene AI projekte (TechStartups). Taj novac jasno pokazuje potrebu vojske za naprednim, autonomnim AI alatima.

Šta sledi?

Ovaj sukob nameće važno pitanje: Može li firma čija je osnovna misija „bezbednost na prvom mestu“ koegzistirati sa klijentom koji želi AI sposoban da razmišlja, planira i deluje na vojnom nivou? Rukovodioci Anthropic-a tvrde da se bezbednost i nacionalna sigurnost ne moraju sukobljavati, ali pritisak Pentagona za korišćenje u „sve zakonite svrhe“ mogao bi naterati firmu da ponovo razmotri svoje crvene linije.

Analitičari industrije upozoravaju da binarno postavljanje stvari — „ili odbacujemo bezbednost ili gubimo odbrambene ugovore“ — stvara lažnu dilemu. Ako Anthropic uspe da demonstrira snažan nadzor koji zadržava ljude u procesu odlučivanja, mogao bi zaštititi i svoj etički stav i unosne poslove u sektoru odbrane.

Za sada, budućnost Claudea unutar poverljivih mreža ostaje neizvesna. Ishod će verovatno oblikovati ne samo putanju Anthropic-a, već i širu debatu o tome kako društvo balansira bezbednost veštačke inteligencije sa imperativima nacionalne bezbednosti.

🔮 Predviđanja futuriste

Predviđanje za 2029:

- Anthropic bi mogao da uvede višeslojni bezbednosni sistem, odvajajući Claude agente civilne namene od strogo kontrolisanog „sandbox“ okruženja namenjenog isključivo Pentagonu. To bi im moglo omogućiti da zadrže imidž kompanije koja bezbednost stavlja na prvo mesto, dok istovremeno zadovoljavaju potrebe vojske za autonomnom analitikom.

- Regulatori bi AI modele koji rade unutar poverljivih mreža mogli da klasifikuju kao „kontrolisane tehnologije dvostruke namene“, što bi pokrenulo novi regulatorni okvir koji primorava kompanije poput Anthropic-a da objavljuju i revidiraju procese rada svojih autonomnih agenata. To bi moglo preoblikovati industrijske standarde za transparentnost AI sistema.

- Javno mnjenje bi se moglo promeniti, izazivajući reakciju koja bi primorala tehnološke kompanije i Pentagon da uspostave hibridne nadzorne odbore. Ta tela bi mogla da usmeravaju buduće ugovore, usmeravajući masovnu primenu AI tehnologije ka obaveznim kontrolnim tačkama uz ljudski nadzor (human-in-the-loop) pri odabiru ciljeva i vršenju nadzora.